В мае на компанию Google Alphabet был подан коллективный иск со стороны группы художников, утверждающих, что их работы использовались для обучения генератора изображений на основе искусственного интеллекта Imagen. Множество других компаний, таких как, например, DeviantArt, столкнулись с аналогичными исками.

Пытаясь найти выход из сложившейся ситуации, исследователи из Техасского университета (Юта) в Остине и Калифорнийского университета в Беркли разработали систему генеративного ИИ на основе диффузии. Эта модель обучается только на тех изображениях, которые заблаговременно были повреждены или изменены до неузнаваемости. Такой подход снижает вероятность того, что ИИ запомнит и воспроизведет оригинальную работу.

Источник: UT at Austin

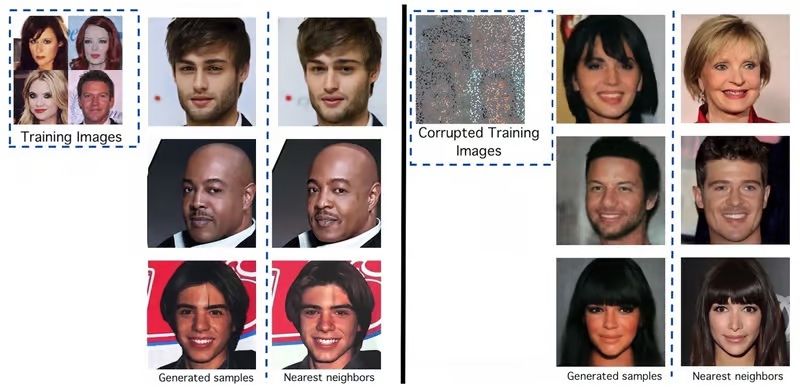

Источник: UT at AustinНа изображении выше показана разница в выводе изображения при использовании повреждения. Исследователи сначала обучали свою модель на высококачественных изображениях знаменитостей. После этого ИИ генерировал изображения, почти идентичные оригиналам (левая панель). Затем исследователи переобучили модель, используя сильно поврежденные фотографии, где до 90% отдельных пикселей были замаскированы случайным образом. Хотя модель создавала реалистичные человеческие лица, результаты были менее похожими (правая панель).

Профессор информатики в UT в Остине и соавтор исследования Адам Кливанс отметил, что эта структура может оказаться полезной для научных и медицинских приложений. Однако как и в случае с существующими генераторами текста в изображение, результаты не всегда идеальны. Однако тот факт, что модель Ambient Diffusion может заставить художников чувствовать себя в безопасности, потому что их работы не будут в точности воспроизведены посредством случайной генерации.

Исследователи сделали свой код и модель Ambient Diffusion открытыми, чтобы стимулировать дальнейшие исследования. Он доступен на GitHub. Об этом сообщает New Atlas.